- セキュリティ

- AI基盤

- その他

生成AI時代の健康診断(Arize AI – ML Observability)

みなさま

サイバーセキュリティ業務などを担当している渡邊です。

生成AIの活用が進む中で、「このAIは本当に正しく動いているのか?」「なぜその答えを出したのか、説明できるのか?」といった不安を感じたことはないでしょうか。

今回は、AIを“使った後”に必要になる管理・可視化・判断の話を扱います。

※本記事は経営者・企画担当・情シス・AI初心者にも分かる視点で解説(エンジニア向け実装編は別途投稿予定)

AIは「放置できない存在」になっている:AIも監視する発想が必要

- AIは導入した瞬間から“管理対象”になる

- 従来のセキュリティではAIの挙動は見えない

- 監視とは、縛ることではなく理解すること

- Security for AIは、AI活用を続けるための条件である

Arize AIは「AIを制御するツール」ではない:どう振舞っているか“観測”

- AIの回答を修正するツール?

- AIを止めるセキュリティ製品?

- ルールでがんじがらめにする管理ツール?

ではありません!Arize AIの役割は、AIが実際にどう振る舞っているかを“観測する”こと。

言い換えると、AIの定期健康診断のような存在です。

「AI Observability」とは何か

Arize AIが掲げている中核の考え方がAI Observability(AIオブザーバビリティ)です。

> AIがブラックボックスにならないよう

>振る舞いを後から確認できる状態にすること

ここで重要なのは、リアルタイムで全部を見ることではありません。

- どんな入力が多いのか

- どんな出力が増えているのか

- 以前と比べて何が変わったのか

といった「傾向」を把握できることが本質です。

ログ監視と、AI監視は何が違うのか

「それってログを見ているのと何が違うの?」と思う方もいるかもしれません。ここが重要なポイントです。

従来のログ監視

- 正常/異常を判定

- エラーや失敗を検知

- 主にシステムの安定性を見る

AIの監視(Arize AI)

- 正解/不正解だけでは測れない

- 「それっぽい間違い」を含む

- 品質・一貫性・偏りを見る

生成AIの問題は、エラーにならないまま間違うことです。だからこそ、

- 成功/失敗の二値

- OK/NGのアラート

だけでは足りません。

人間で考えると分かりやすい

ここで、AIを「人間の社員」に例えてみましょう。

- 出勤しているか → システムは動いている

- ミスをしていないか → エラーは出ていない

これだけでは、その社員が良い仕事をしているかどうかは分かりません。

- 最近、判断が雑になっていないか

- 以前より説明が曖昧になっていないか

- 特定のケースで偏った判断をしていないか

Arize AIが見ているのは、まさにこの “仕事ぶりの変化” です。

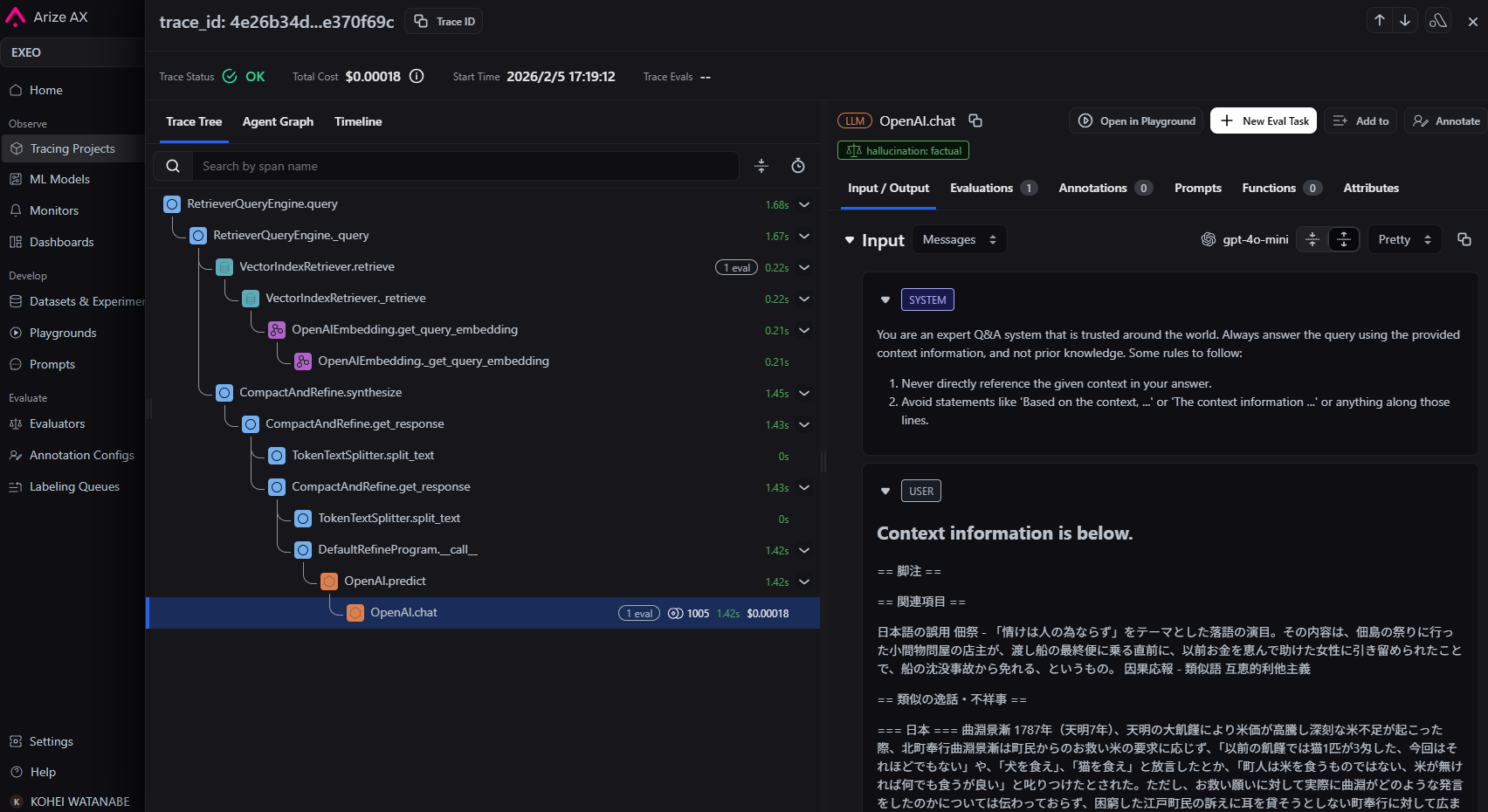

Arize AIで「見えるようになる」もの

Arize AIを使うことで、例えば次のようなことが後から振り返れるようになります。

- 回答の品質が時間とともにどう変わったか

- 特定の入力でだけおかしな反応が出ていないか

- 想定外の使われ方が増えていないか

- ユーザー体験が劣化していないか

重要なのは、「事故が起きた後」ではなく「起きる前の兆候」に気づける点です。

Security for AIとの関係性

Security for AIが問いかけているのは、

- なぜAIは従来のセキュリティでは守れないのか

- なぜAIは説明責任を求められるのか

- なぜ“使い続ける”ことが難しいのか

という 思想・構造の問題です。Arize AIは、その思想を 現場で成立させるための一つの手段 と言えます。

> Security for AI = なぜ必要か

> Arize AI = どう実現するか

という関係です。

おわりに

AI活用が進めば進むほど、「見えないまま使う」ことが最大のリスクになります。

Arize AIは、AIを疑うためのツールではなく、AIを信頼し続けるための前提条件を整える存在だと言えるでしょう。

現在「東京エレクトロン デバイス株式会社」様ご協力の元、ArizeAIのPoCを実施し詳細な機能検証を行っています。

実装方法やダッシュボード活用の仕方などは別途投稿予定となります。

Arize AI(米国Arize AI, Inc.)の日本国内における販売代理店